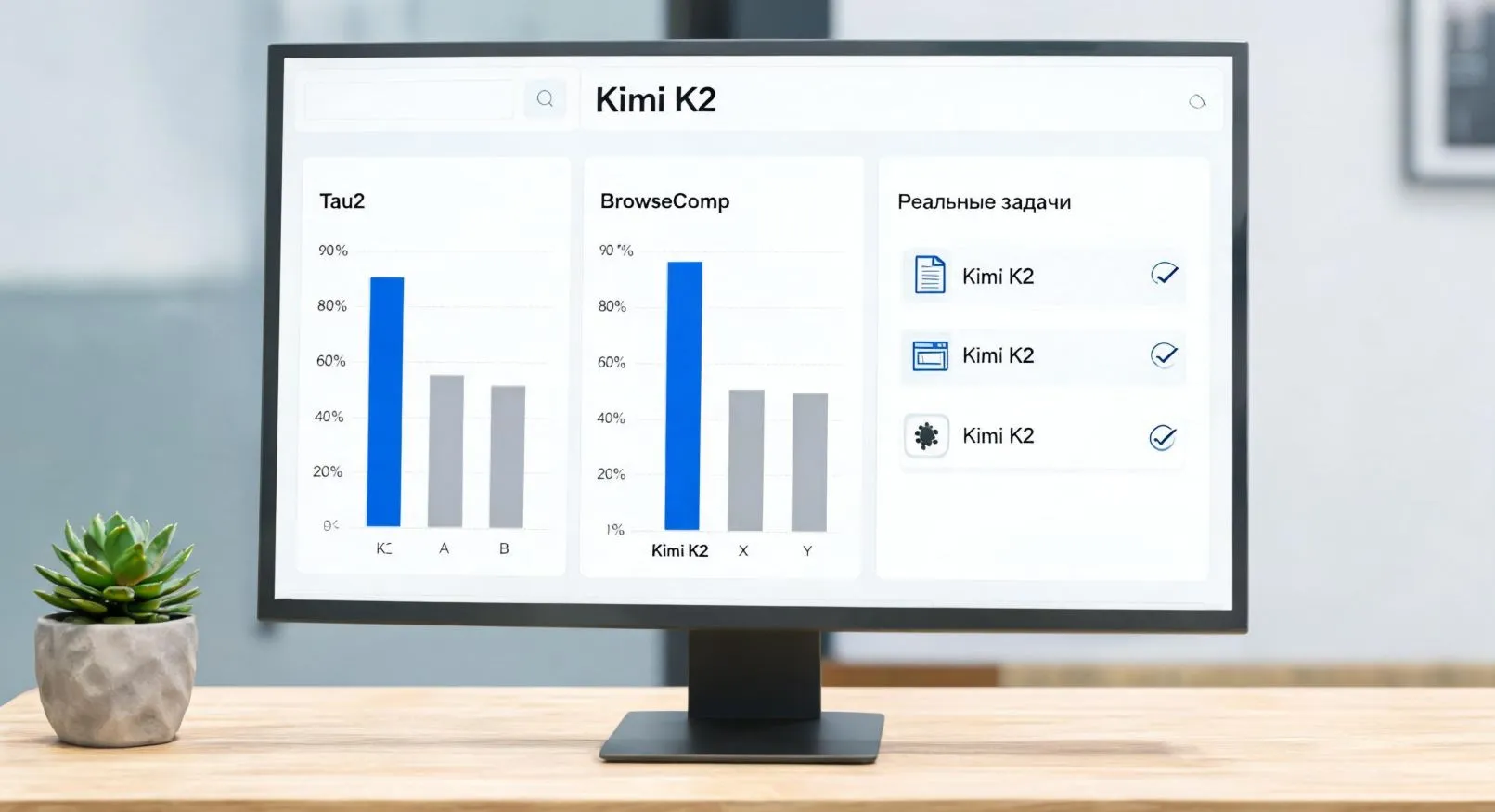

Kimi K2 в агентных бенчмарках: Tau2, BrowseComp и реальные задачи

Kimi K2 стал заметной моделью не только из-за размера и открытости, но и из-за ориентации на агентные сценарии. Для обычного чат-бота достаточно хорошо отвечать на вопросы. Для агентной модели этого мало: она должна планировать шаги, вызывать инструменты, искать информацию, проверять промежуточные результаты, сохранять цель в длинной цепочке действий и не ломаться, когда задача требует десятков операций подряд.

Именно поэтому вокруг Kimi K2 так много внимания к тестам вроде Tau2 и BrowseComp. Они ближе к реальной работе: модель должна вести диалог, пользоваться инструментами, искать труднодоступную информацию, соблюдать правила, реагировать на изменения и доводить задачу до правильного результата. BrowseComp измеряет способность агента находить сложную, запутанную информацию в интернете, а Tau2 проверяет, как агент действует в симуляции клиентского сервиса, где и пользователь, и агент могут менять состояние задачи.

Для Kimi K2 это важный тест зрелости. Модель может быть сильной в коде или рассуждении, но агентные задачи показывают другое качество: насколько она способна работать как исполнитель в многошаговом процессе. В реальном проекте это означает обработку обращений, поиск по базе знаний, анализ документов, выполнение действий через API, подготовку отчетов, проверку данных и помощь разработчику не одним ответом, а последовательностью шагов.

Почему агентные бенчмарки важнее обычных тестов

Обычные тесты часто оценивают один ответ. Модель получает вопрос, генерирует решение, затем результат сравнивается с правильным. Такой формат полезен, но он плохо показывает, как модель поведет себя в рабочем процессе. В реальной задаче нужно не только знать ответ, но и выбрать действие, вызвать инструмент, дождаться результата, исправить ошибку, уточнить контекст и продолжить.

Агентные тесты ближе к тому, как ИИ используют в продуктах. Например, ассистент поддержки должен не просто сказать клиенту «перезагрузите устройство», а понять проблему, проверить статус аккаунта, объяснить шаги, попросить пользователя выполнить действие, обновить данные через инструмент и завершить обращение по правилам компании. Агент для поиска должен не просто угадать ответ, а пройти по источникам, найти нужный фрагмент, отделить похожие факты и вернуть точную проверяемую информацию.

Поэтому агентная модель оценивается по устойчивости всей цепочки. Один хороший ответ уже не гарантирует качество. Важны планирование, соблюдение инструкций, работа с инструментами, память о цели, способность исправляться и экономия шагов. Именно эти свойства делают Kimi K2 интересным в сравнении с обычными «чатовыми» моделями.

Что такое Tau2 и почему он сложен

Tau2 — это тест для разговорных агентов, где задача строится вокруг взаимодействия пользователя, агента и инструментов. В таких сценариях модель должна не просто отвечать вежливо, а выполнять процедуру: выяснить состояние, следовать правилам, использовать доступные действия, направлять пользователя и довести ситуацию до нужного результата. В telecom-сценариях агент может разбираться с мобильными данными, роумингом, SIM-картой, настройками устройства и состоянием аккаунта.

Сложность Tau2 в том, что успех зависит от координации. Пользователь тоже выполняет действия, а среда меняется по ходу диалога. Если агент пропустил шаг, дал неверную инструкцию или нарушил правило, сценарий может не засчитаться. Поэтому высокий результат в Tau2 говорит не только о знаниях модели, но и о ее способности управлять процессом.

Kimi K2 Thinking получил особенно сильное внимание из-за результата 93% в Tau2 Telecom. Такой показатель важен не как абстрактная цифра, а как сигнал: модель хорошо справляется с агентными задачами, где требуется диалог, инструменты, последовательность действий и соблюдение условий.

Что показывает BrowseComp

BrowseComp проверяет другую сторону агентности — поиск сложной информации. В нем 1 266 задач, где агент должен искать ответ в интернете, переходить между страницами, сопоставлять факты и находить короткий проверяемый результат. Это не обычный веб-поиск по очевидной фразе. Задачи специально построены так, чтобы ответ был труднодоступным, запутанным и требовал настойчивости.

Для модели такой тест сложен по нескольким причинам. Нужно сформулировать поисковую стратегию, не застрять на первом похожем результате, проверять источники, отделять совпадения от правильного ответа и не выдумывать недостающие факты. В реальной работе похожие задачи возникают постоянно: найти точную дату, сравнить данные из разных документов, проверить утверждение, подготовить справку по рынку, собрать информацию о конкуренте или найти причину расхождения в отчетах.

Kimi K2.6 получил заметный результат на BrowseComp — 83,2% в одном из свежих наборов бенчмарков. Для открытой модели это сильная заявка именно на агентный поиск: не просто ответить из памяти, а выполнять исследовательскую задачу через поиск, инструменты и проверку.

Почему Kimi K2 хорошо смотрится в агентных задачах

Сильная сторона Kimi K2 — сочетание нескольких качеств. Модель построена как смесь экспертов с крупным общим объемом параметров и сравнительно меньшим числом активных параметров на запрос. Такой подход помогает держать баланс между масштабом, качеством и эффективностью вывода. Kimi K2 также развивался с акцентом на агентные способности: код, инструменты, рассуждение, длинный контекст и устойчивую работу в цепочках действий.

Модель должна хорошо следовать инструкциям, вызывать инструменты в нужный момент, не терять состояние, сохранять формат результата и понимать, когда нужно продолжить поиск. Kimi K2.6 в свежем релизе делает акцент на более тщательном исследовании, лучшем следовании инструкциям и снижении числа ошибок в кодовых задачах, что напрямую связано с агентной надежностью.

Где агентные бенчмарки близки к реальности

Tau2 и BrowseComp важны потому, что они проверяют качества, которые действительно нужны в продуктах. В поддержке клиентов агент должен соблюдать регламент и доводить обращение до результата. В поисковых задачах — находить факты, а не писать уверенные предположения. В коде — не только генерировать функцию, но и проверять проект, запускать шаги, исправлять ошибки, работать с файлами и инструментами.

В реальной компании такие сценарии выглядят так:

- Ассистент поддержки классифицирует обращение, ищет инструкцию и готовит ответ;

- Внутренний агент ищет нужный документ в базе знаний и делает краткую выжимку;

- Аналитический агент собирает данные из нескольких источников и готовит отчет;

- Кодовый агент читает задачу, меняет файлы, пишет тесты и объясняет правки;

- Исследовательский агент ищет факты, сравнивает источники и возвращает проверяемый вывод;

- Операционный агент вызывает API, обновляет статус и фиксирует результат в системе.

Такой список показывает, почему агентные бенчмарки стали важны. Они ближе к бизнес-задачам, чем обычный вопрос-ответ. Для Kimi K2 сильные результаты в таких тестах означают, что модель можно рассматривать не только как чат, но и как основу для рабочих агентов.

Kimi K2 и кодовые агенты

Код — одна из главных зон, где агентность проявляется особенно ярко. Простой помощник пишет функцию по запросу. Агентный помощник работает иначе: читает задачу, понимает структуру проекта, находит нужные файлы, вносит правки, запускает тесты, анализирует ошибку, исправляет код и повторяет цикл. Для этого нужна устойчивость в длинной цепочке действий.

Kimi K2.6 активно позиционируется как модель для сложного агентного кодинга. В релизных материалах фигурируют длинные рабочие сессии, большое число вызовов инструментов и способность решать задачи в разных языках и областях, включая фронтенд, DevOps и оптимизацию производительности.

Для разработчиков это важнее, чем одиночный пример кода. Модель должна не только написать компонент, но и понять требования, не сломать проект, не использовать хаки, соблюдать стиль, предложить тесты и объяснить, что было изменено. Именно поэтому агентные бенчмарки по коду и инструментам стали одним из главных способов оценивать новые модели.

Что значат результаты Kimi K2.6

Kimi K2.6 выглядит как шаг от сильной открытой модели к более практичному агентному инструменту. В свежих материалах по релизу акцент сделан на коде, агентных задачах, BrowseComp, long-horizon coding и многошаговой работе с инструментами. Среди показателей выделяются 83,2% на BrowseComp, 58,6% на SWE-Bench Pro, 76,7% на SWE-bench Multilingual и 54,0% на HLE с инструментами.

Модель стала серьезным кандидатом для агентных сценариев, особенно если важны открытость, код, длинные цепочки действий и стоимость. В некоторых задачах закрытые флагманы могут оставаться сильнее, особенно если нужна максимальная надежность, мультимодальность или встроенная экосистема инструментов.

Для реального проекта главное — не общий рейтинг, а поведение на своих задачах. Если агент должен работать с кодом, нужно тестировать его на своем репозитории. Если нужен поиск, стоит проверять на своих исследовательских запросах. Если нужен клиентский сервис, нужно моделировать реальные обращения, правила и инструменты компании.

Агентные сценарии Kimi K2

Ниже — практическая схема, которая помогает понять, где результаты Tau2, BrowseComp и кодовых тестов ближе всего к реальному использованию.

| Сценарий | Что проверяет бенчмарк | Где это нужно в проекте | Что проверять дополнительно |

|---|---|---|---|

| Клиентская поддержка | Диалог, правила, инструменты, изменение состояния | Помощник поддержки, контакт-центр, внутренние инструкции | Тон, регламенты, права доступа, ошибки в процедурах |

| Агентный поиск | Настойчивый поиск, сопоставление источников, точный ответ | Исследования, конкурентный анализ, фактчекинг, справки | Качество источников, свежесть данных, отсутствие догадок |

| Кодовый агент | Длинные цепочки правок, тесты, инструменты, исправления | Разработка, ревью, исправление ошибок, автогенерация интерфейсов | Запуск тестов, безопасность, стиль проекта |

| Аналитика документов | Длинный контекст, извлечение фактов, структурирование | Отчеты, договоры, протоколы, базы знаний | Даты, суммы, версии файлов, полнота выборки |

| Многоагентные процессы | Координация нескольких шагов и ролей | Автоматизация задач, пайплайны, исследовательские агенты | Контроль стоимости, логи, остановка при ошибках |

| Инструментальные задачи | Вызов API, проверка результата, повторные шаги | CRM, helpdesk, внутренние панели, DevOps | Валидация, права, откаты, аудит действий |

Почему один высокий балл ничего не гарантирует

Высокий результат в Tau2 или BrowseComp — сильный сигнал, но он не заменяет тестирование в своем продукте. Бенчмарки обычно фиксируют конкретные условия: формат задачи, набор инструментов, правила оценки, тип ответа и ограниченный набор сценариев. В реальности данные грязнее, пользователи непредсказуемее, документы устаревшие, API нестабильны, а требования компании могут отличаться от тестовой среды.

Например, агент может хорошо пройти BrowseComp, но в вашей системе хуже работать с внутренней базой знаний из-за плохой структуры документов. Или модель может быть сильной в Tau2 Telecom, но ошибаться в банковских сценариях, где правила сложнее и выше цена ошибки. Кодовый агент может хорошо решать публичные задачи, но хуже понимать закрытый проект с нестандартной архитектурой.

Поэтому бенчмарк стоит воспринимать как фильтр. Он помогает понять, какие модели стоит тестировать. Финальный выбор делается на своих данных, своих инструментах и своих требованиях к качеству.

Как тестировать Kimi K2 на реальных задачах

Для оценки Kimi K2 в проекте лучше собрать набор реальных сценариев. Не нужно начинать с сотен задач. Достаточно 30–50 типовых запросов: клиентские обращения, документы, поисковые задачи, кодовые ошибки, аналитические запросы, инструкции и операции через инструменты.

Тестирование должно проверять не только качество ответа, но и поведение цепочки. Агент может правильно начать, но ошибиться на третьем шаге. Может вызвать инструмент без необходимости. Может сделать лишние действия. Может не остановиться, когда данных недостаточно. Может вернуть красивый вывод без проверки.

Практичный порядок:

- Собрать реальные задачи из будущего продукта.

- Разделить их на классы: поддержка, поиск, код, документы, аналитика, API-действия.

- Задать для каждой задачи критерий успеха.

- Проверить не только финальный ответ, но и шаги агента.

- Оценить стоимость, задержку, число вызовов инструментов и ошибки.

- Сравнить Kimi K2 с 2–3 альтернативными моделями.

- Оставить Kimi только в тех сценариях, где он стабильно выигрывает по качеству, цене или контролю.

Такой подход защищает от типичной ошибки: выбрать модель по громкому результату в бенчмарке, а затем обнаружить, что в реальном процессе она требует слишком много ручной проверки.

Как проектировать агента на Kimi K2

Для агентной системы недостаточно просто подключить модель через API. Нужна архитектура вокруг модели: инструменты, права, логи, валидация, ограничения, fallback, контроль стоимости и правила остановки. Чем больше действий может выполнить агент, тем важнее контроль.

У агента должны быть четкие границы. Например, он может читать документы, классифицировать обращение и готовить черновик ответа, но не может сам обещать компенсацию. Может анализировать код и предлагать патч, но финальный merge проходит через разработчика. Может искать информацию, но обязан показывать основания и помечать сомнительные выводы.

Для Kimi K2 особенно важно проектировать шаги так, чтобы модель не тратила лишние вызовы инструментов. Агентные задачи быстро увеличивают стоимость: поиск, вызовы API, длинный контекст, повторные проверки, генерация отчетов. Поэтому нужно ограничивать число шагов, размер контекста, формат ответа и условия повторной попытки.

Где Kimi K2 может быть особенно полезен

Kimi K2 стоит рассматривать в задачах, где важны открытость, агентность, код, инструменты и контроль. Например, команда хочет построить внутреннего помощника по документации, агентного кодового ассистента, систему обработки обращений, поискового агента по открытым источникам, аналитика для отчетов или инструмент для генерации интерфейсов.

Для стартапа Kimi K2 может быть интересен как способ снизить зависимость от закрытых моделей. Для корпорации — как вариант для контролируемых сценариев, где важна возможность настройки и развертывания. Для разработчиков — как база для агентных инструментов вокруг кода, тестов, багов и документации.

Особенно хорошо Kimi K2 выглядит в сценариях, где нужно много последовательных действий, но можно выстроить валидацию. Например: агент анализирует обращение, но ответ проверяет оператор. Агент ищет информацию, но показывает источники. Агент готовит код, но тесты и ревью обязательны. Агент создает отчет, но аналитик сверяет цифры.

Где нужно быть осторожнее

Агентные модели опасны не потому, что отвечают хуже, а потому, что могут действовать дальше обычного чата. Если модель вызывает инструменты, меняет данные, отправляет запросы или управляет процессом, ошибка становится дороже. Поэтому Kimi K2 нельзя сразу выпускать на критичные действия без ограничений.

Риски особенно высоки в финансах, медицине, праве, персональных данных, платежах, доступах, клиентских обещаниях и инфраструктуре. В таких сценариях агент должен работать в режиме черновика или помощника, а важные действия подтверждает человек или отдельная система правил.

Также стоит учитывать длинные цепочки. Чем больше шагов выполняет агент, тем выше шанс накопительной ошибки. Даже если каждый шаг выглядит разумно, итог может уйти в сторону. Поэтому нужны лимиты, промежуточные проверки, остановка при неопределенности и журнал действий.

Как читать бенчмарки без самообмана

Бенчмарк полезен, если понимать, что именно он измеряет. Tau2 показывает способность агента вести диалог, использовать инструменты и соблюдать условия в симуляции клиентского сервиса. BrowseComp показывает настойчивость и точность в веб-поиске. Кодовые тесты показывают способность менять и проверять программы. Это разные навыки, и высокий результат в одном не автоматически означает лидерство в другом.

Также важно смотреть на условия: была ли модель с инструментами, сколько было попыток, какой контекст, какой режим рассуждения, какие лимиты, как считался успех. Агентные результаты особенно чувствительны к окружению. Один и тот же базовый интеллект может дать разные результаты в зависимости от инструментов, промпта, памяти, браузера и проверок.

Для Kimi K2 это значит: сильные цифры в Tau2, BrowseComp и кодовых тестах делают модель интересной для пилотов. Но внедрение должно начинаться с внутренней оценки, а не с доверия к таблице.

Kimi K2 подходит для задач, где модель выполняет несколько действий подряд: читает данные, выбирает

Kimi K2 стал заметной моделью не только из-за размера и открытости, но и из-за ориентации на агентны

Мир искусственного интеллекта развивается так быстро, что разница между моделями, вышедшими с интерв

В эпоху развития искусственного интеллекта проблема качества рассуждения моделей становится всё боле

Современные языковые модели, подобные Kimi K2, стремятся не только давать точные ответы, но и объясн